OpenClaw 接入可观测功能

背景

当前 OpenClaw 凭借其卓越的自主执行能力,从基础文件处理到复杂的系统命令调用,已成为开发者心目中高效的“数字员工”。然而,这种强大的自主性也带来了一个巨大的挑战:行为的不可见性与成本的不可预测性。

OpenClaw 缺乏可观测性导致三大核心痛点:

- 成本黑洞:随着 OpenClaw 执行任务的复杂度,持续累积的上下文以及多轮的递归推理,往往会在后台悄无声息地消耗大量 Token,企业无法精准知晓Token消耗节点,成本优化无从下手;

- 排障黑盒:OpenClaw处理大量请求,内部会产生多环节链路,缺乏可观测性导致推理链路如同黑盒,缺少追踪让排障只能靠猜;

- 被动发现问题:系统状态不可见,故障只能在用户投诉后才后知后觉,无法实现主动监控和预防。

解决方案

为了破解 AI 应用的“黑盒”困境,“BCM云监控->LLM应用性能监控”提供了从会话到模型调用的全链路监控方案。得益于 OpenClaw 内置的 diagnostics-otel 插件,系统可以基于标准 OpenTelemetry 协议自动采集运行时事件。

通过将 OpenClaw 的观测数据接入 LLM应用性能监控,您可以实现以下三大核心价值:

- 全透明成本监控: 利用内置看板实时追踪 Token 消耗走势,确保每一笔模型调用支出都清晰可见。

- 深度根因定位: 将 Token 消耗数据与具体的调用链(Trace)及上下文长度进行关联分析,精准锁定导致高额成本的具体逻辑或任务节点。

- 异常行为自动预警: 针对心跳检测异常或后台任务过度消耗等场景设置阈值,在成本失控前及时介入(即将支持)。

前提条件

- 使用 OpenClaw 2026.3.2 及以上版本

- 开通“BCM云监控->LLM应用性能监控”

接入可观测数据

步骤1:进入目录下载可观测插件相关依赖

1cd /usr/lib/node_modules/openclaw/extensions/diagnostics-otel/

2npm install步骤2:启动可观测插件

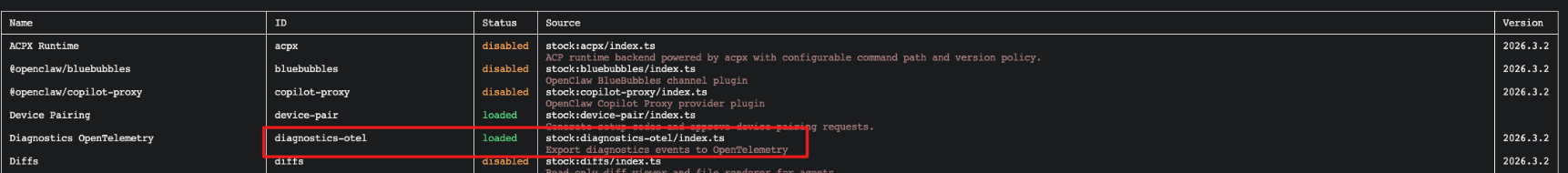

1openclaw plugins enable diagnostics-otel启动完成后,执行 openclaw plugins list 命令查看插件状态,预期状态为 loaded。

步骤3:在 ~/.openclaw/openclaw.json 文件中,添加如下 diagnostics-otel 数据上报配置,示例如下:

其中 endpoint 以及 authentication,请前往 “云监控BCM->LLM应用性能监控" 接入应用页面查看。serviceName 表示 在"LLM应用性能监控->应用列表"中显示的服务名,可根据实际情况自定义。本场景以 openclaw 为例。

1{

2 "previous configs": {

3 ...

4 },

5 "plugins": {

6 "entries": {

7 // 插件默认已经开启

8 "diagnostics-otel": {

9 "enabled": true

10 }

11 }

12 },

13 // 插件导出数据相关配置

14 "diagnostics": {

15 "enabled": true,

16 "otel": {

17 "enabled": true,

18 "endpoint": "http://apm-collector.bj.baidubce.com",

19 "protocol": "http/protobuf",

20 "headers": {

21 "authentication": "It******sE"

22 },

23 "serviceName": "openclaw",

24 "traces": true,

25 "metrics": true,

26 "logs": true,

27 "flushIntervalMs": 30000

28 }

29 }

30}步骤4:配置完成后,执行以下命令重启 OpenClaw gateway 服务。

1openclaw gateway restart查看OpenClaw可观测数据

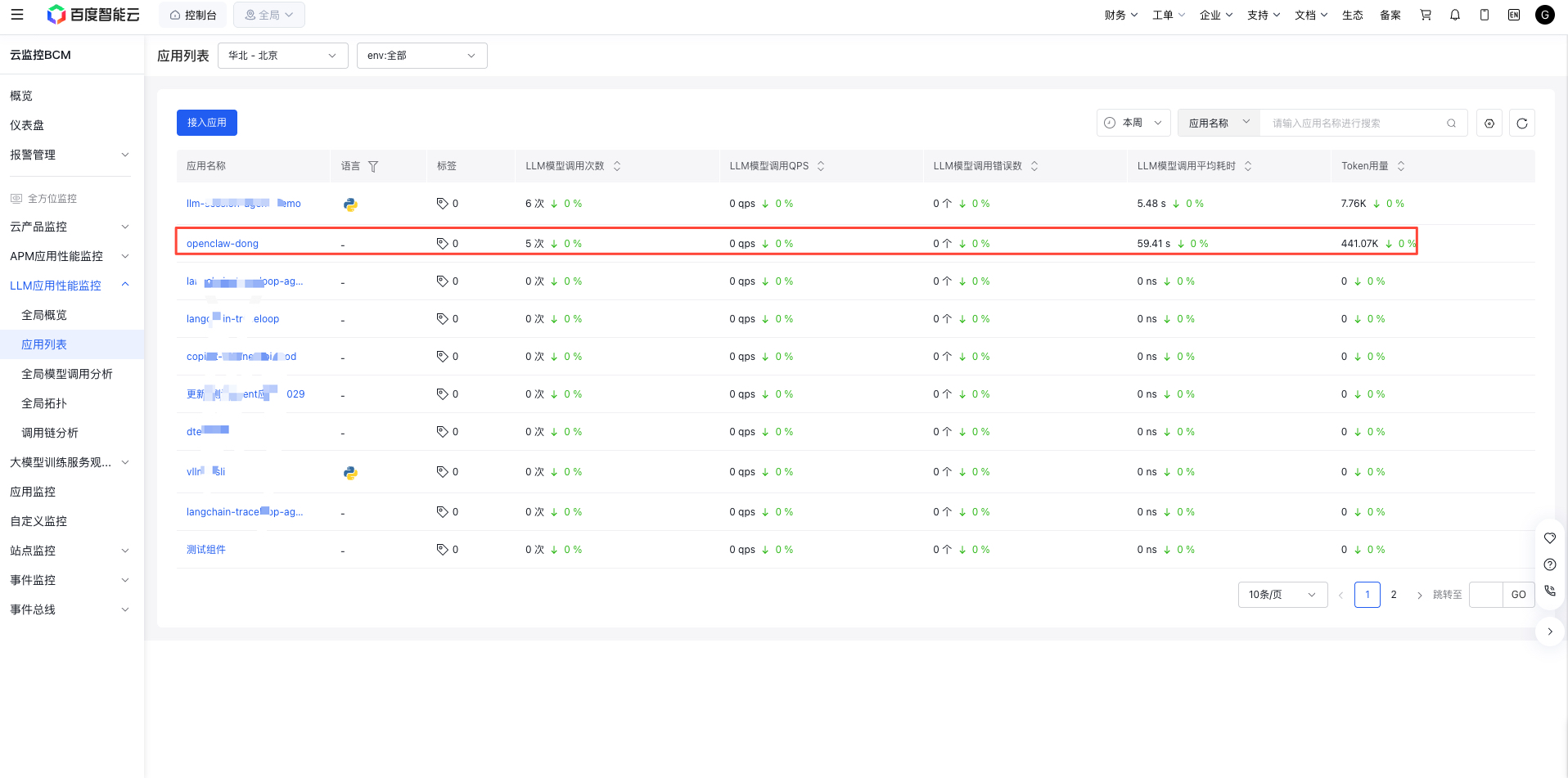

通和OpenClaw进行对话交互后,可前往“BCM云监控->LLM应用性能监控”平台查看观测数据 1.在“LLM应用性能监控->应用列表”找到已经接入的 OpenClaw应用。

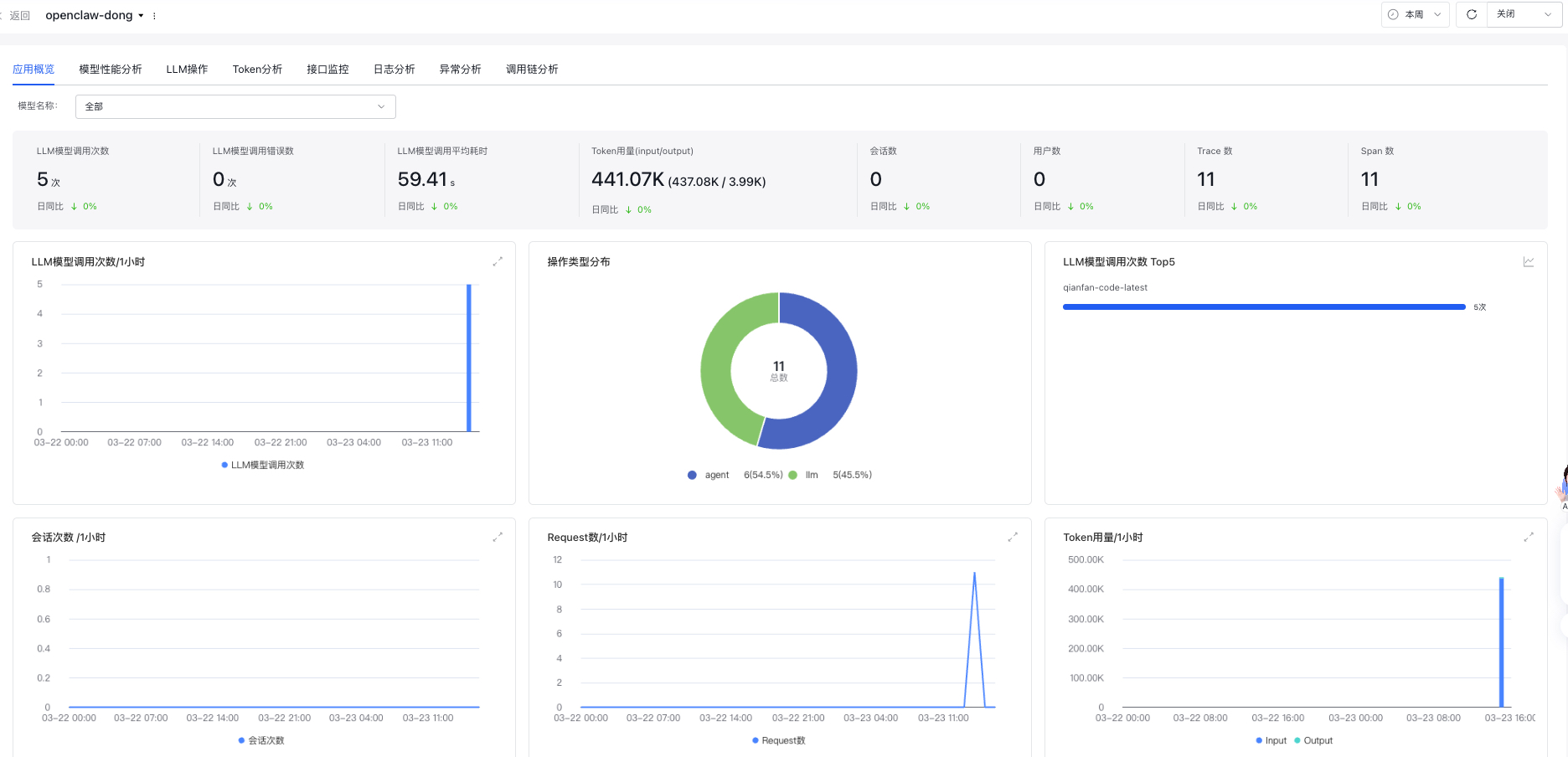

2.点击应用名称,进入到应用详情页,展示应用概览、模型调用分析、LLM操作、Token分析等内置看板。后续所有指标均可配置阈值报警,问题发生时第一时间通知,及时发现异常。

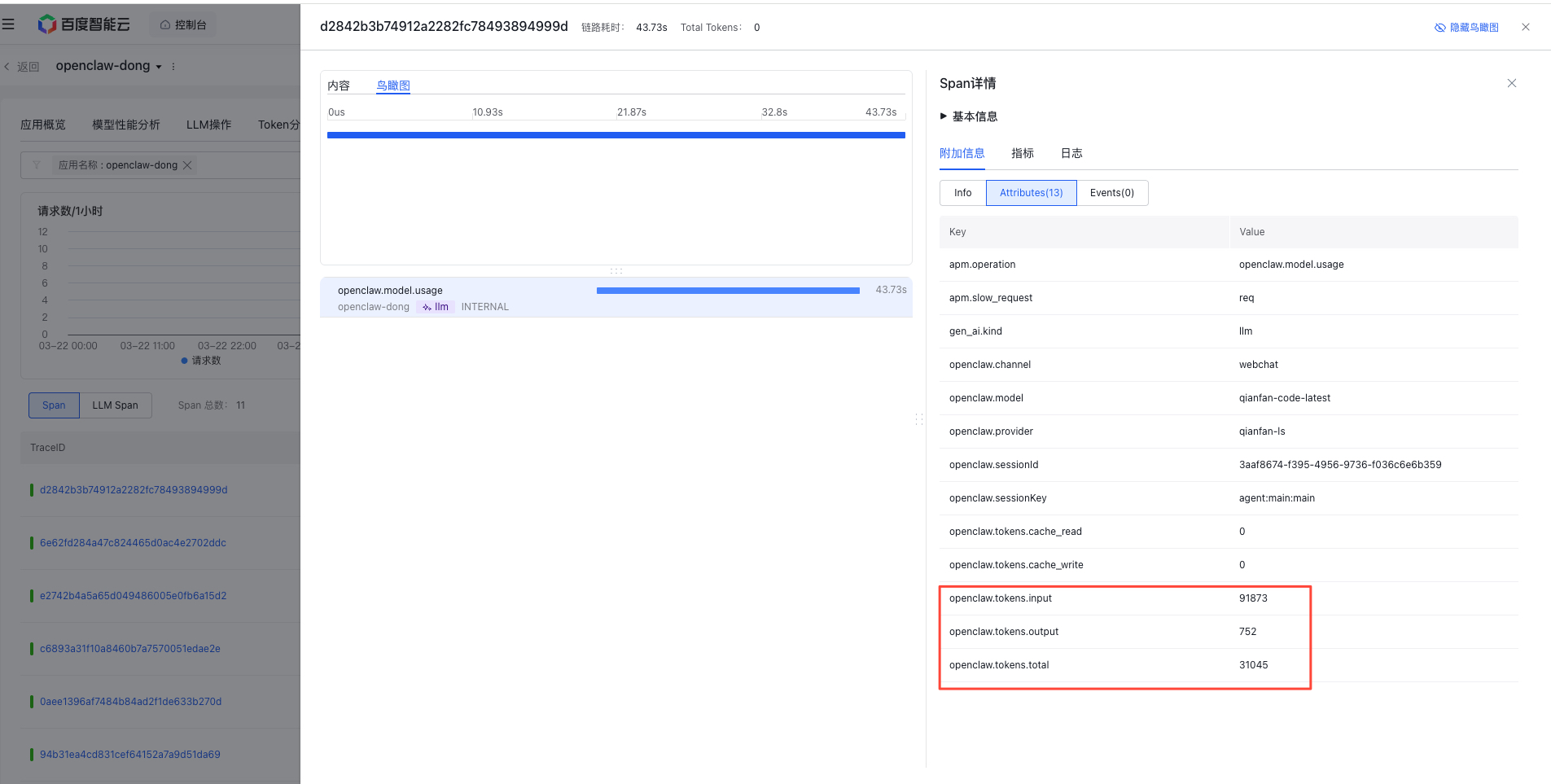

3.点击应用详情里的调用链分析Tab,查看OpenClaw应用所有的Trace和Span数据。

4.点击目标 Trace ID,可清晰查看每一次请求调用链路,告别排障黑盒。切换到属性页签,可查看本次请求的详细信息,如:模型名称、Token消耗等,让企业清楚掌握每一次调用的 Token 成本具体花在何处。

评价此篇文章