Jetson资源监控

更新时间:2022-03-29

前言

本文介绍百度智能边缘BIE如何纳管 NVIDIA Jetson设备,并实现对Jetson的资源监控。

实验设备

一台 NVIDIA Jetson NX 设备,参数信息如下:

- 操作系统:Ubuntu 18.04 desktop

- 边缘侧安装 k3s+docker

- Jetpack: 4.5

操作指南

- 创建一个边缘节点,AI加速卡选择NVIDIA Jetson,如下图所示:

- 进入到节点详情界面,点击安装,在弹出框当中复制节点安装命令,然后在边缘节点上运行。

- NVIDIA Jetson默认安装了docker,因此只需要安装k3s即可。

- 需要确认Jetson已经开启了NVIDIA Docker Runtime,开启方法可以参考Jetson依赖说明。

- 安装jtop插件,用于查看jetpack版本和GPU使用率。安装方法参考参考Jetson依赖说明。执行

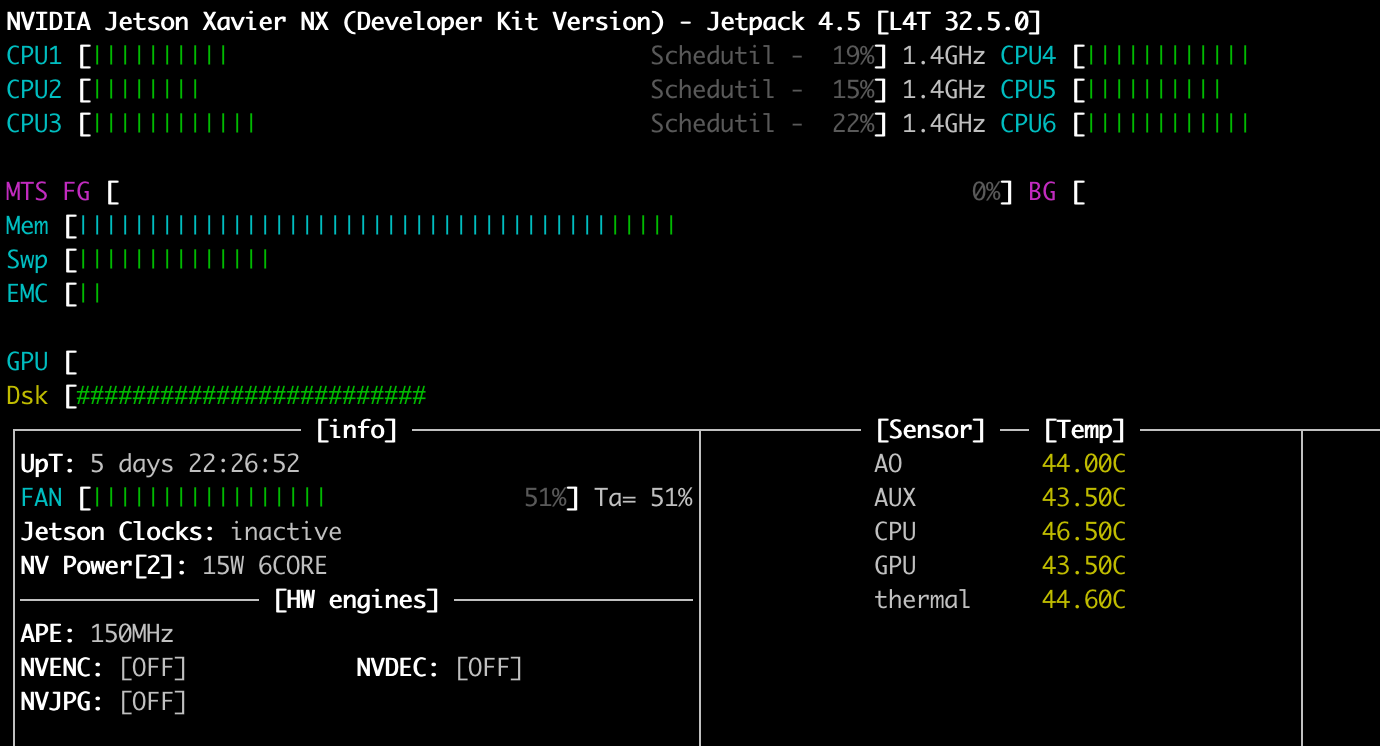

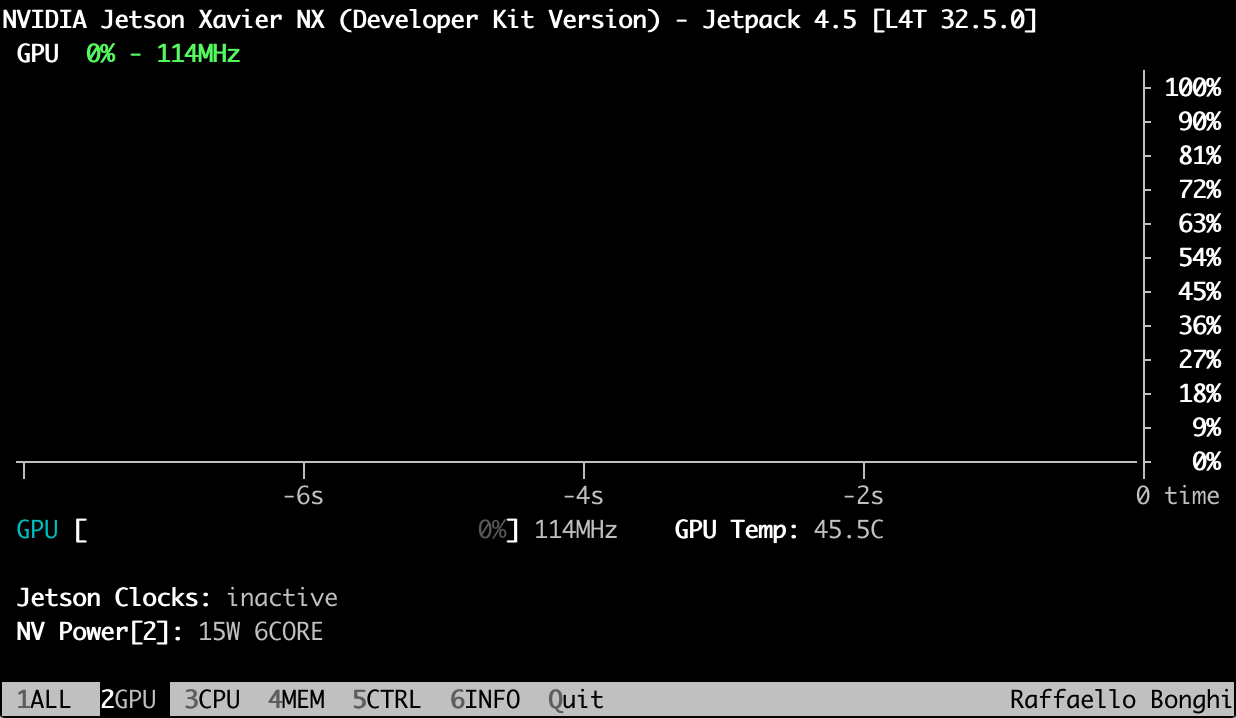

sudo jtop,查看jetpack版本为4.5,GPU使用率为0,如下图所示:

- 节点安装边缘以后,我们在边缘侧可以看到一个叫做baetyl-gpu-metrics的pod,由它负责采集AI加速卡的资源使用信息。

Bash

1nvidia@miivii-tegra:~$ kubectl get pod -A

2NAMESPACE NAME READY STATUS RESTARTS AGE

3kube-system metrics-server-7566d596c8-tzk6n 1/1 Running 0 11m

4kube-system coredns-7944c66d8d-8vd4d 1/1 Running 0 11m

5baetyl-edge-system baetyl-init-6469b8c94d-9xph5 1/1 Running 0 3m52s

6baetyl-edge-system baetyl-core-hxpcag87w-869778cdfd-jt5mm 1/1 Running 0 3m34s

7baetyl-edge-system baetyl-agent-9fnnedhv8-2h6sn 1/1 Running 0 3m19s

8baetyl-edge-system baetyl-broker-ahemegxev-66758965c9-lm27z 1/1 Running 0 3m18s

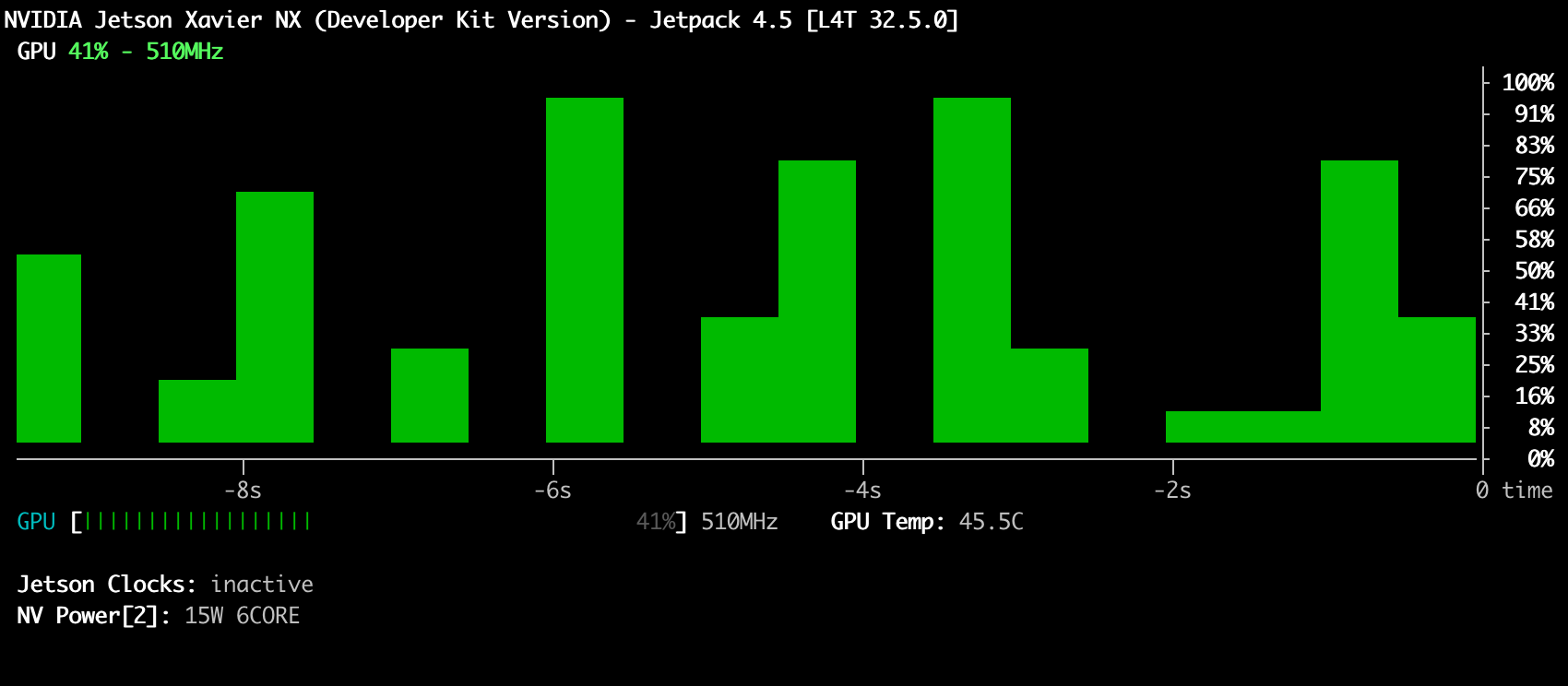

9baetyl-edge-system baetyl-gpu-metrics-6fgh9ygbr-5lz79 1/1 Running 0 3m17s- 执行一个AI模型服务调用脚本,AI模型使用AI加速卡算力资源。

- 在边缘侧使用

jtop查看资源使用率,如下所示,资源使用率在10%~50%之间

- 返回到云端节点详情,找到AI加速卡,查看AI加速卡资源监控信息,如下所示:

- 边缘端与云端指标映射信息如下表所示:

| 边缘端 | 云端 | 数值 | 备注 |

|---|---|---|---|

| - | 编号 | 1 | |

| Type | 名称 | NVIDIA Xavier NX GPU | |

| GPU Temp | 温度(℃) | 46 | |

| NV Power | 能耗(W) | 15 | |

| Mem | 显存使用情况 | 3.64 GiB/7.59 GiB | 显存、内存共享8GiB容量,此处3.64GiB实际是显存+内存 |

| GPU | GPU使用率 | 47.94% | 云端计算值,实际使用内存/内存容量 |

评价此篇文章