VPC网络SASL_PLAINTEXT方式生产和消费消息

在同 VPC 网络下访问,使用 SASL_PLAINTEXT 协议接入,接入点可以在 集群详情 页面查看。

环境准备

集群准备

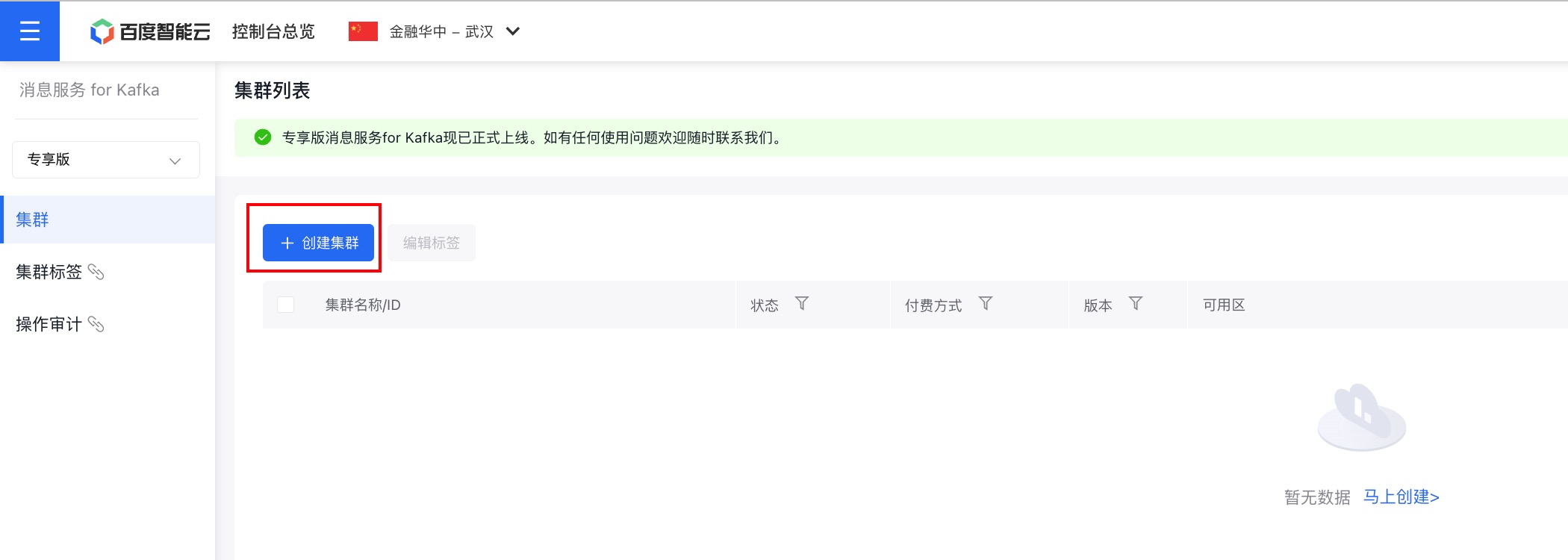

1. 购买专享版消息服务for Kafka集群

开通消息服务 for Kafka服务后,在控制台页面点击『创建集群』,即可进行购买。

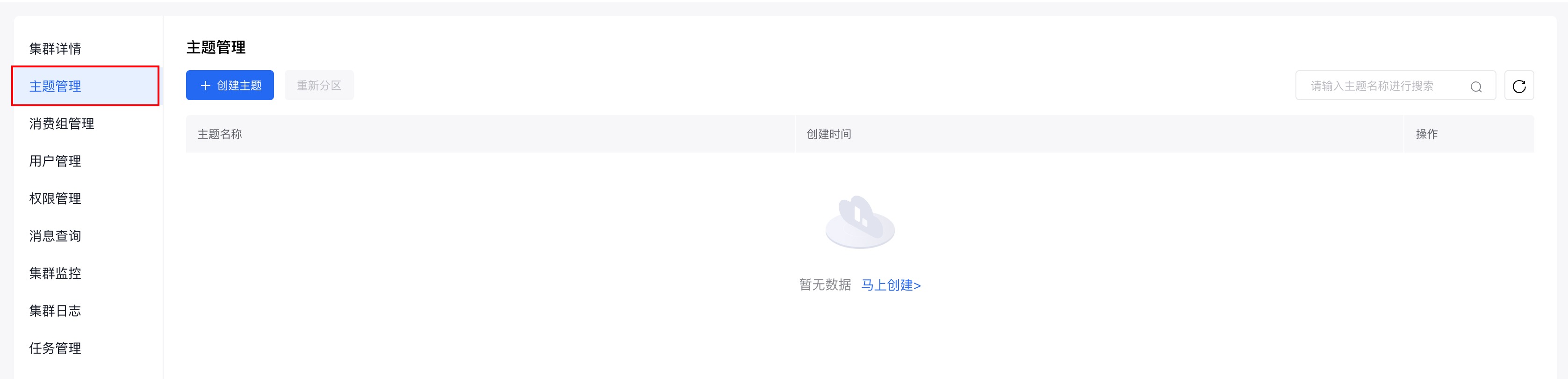

2. 为购买的集群创建主题

在控制台页面点击集群名称,进入集群详情页面。

在左侧的边栏中点击『主题管理』,进入主题管理页面。

在主题管理页面点击『创建主题』,进行主题的创建。

使用步骤:

步骤一:获取集群接入点

具体请参考:接入点查看。

步骤二:添加Maven配置

1 <dependencies>

2 <dependency>

3 <groupId>org.apache.kafka</groupId>

4 <artifactId>kafka-clients</artifactId>

5 <version>2.7.2</version>

6 </dependency>

7 <!-- https://mvnrepository.com/artifact/org.apache.maven.plugins/maven-assembly-plugin -->

8 <dependency>

9 <groupId>org.apache.maven.plugins</groupId>

10 <artifactId>maven-assembly-plugin</artifactId>

11 <version>3.5.0</version>

12 </dependency>

13 </dependencies>步骤三:创建JAAS 配置文件

创建 jaas 配置文件 kafka_client_jaas.conf,认证机制支持PLAIN、SCRAM-SHA-512两种机制,根据集群所使用的认证方式进行选择。

SCRAM-SHA-512:

1KafkaClient {

2 org.apache.kafka.common.security.scram.ScramLoginModule required

3 username="{username}"

4 password="{password}";

5};PLAIN:

1KafkaClient {

2 org.apache.kafka.common.security.plain.PlainLoginModule required

3 username="{username}"

4 password="{password}";

5};username,password 填创建用户时设置的值。

步骤四:创建kafka.properties配置文件

提供接入 Kafka 服务需要的配置信息,配置项如下:

- bootstrap.servers 配置为接入点地址,具体请参考接入点查看。

- security.protocol 固定为 SASL_PLAINTEXT

- sasl.mechanism 固定为 SCRAM-SHA-512或者PLAIN,根据集群所使用的认证方式进行选择

- java.security.auth.login.config 配置为 kafka_client_jaas.conf 路径

1bootstrap.servers=<接入点地址>

2

3security.protocol=SASL_PLAINTEXT

4

5sasl.mechanism=SCRAM-SHA-512

6# sasl.mechanism=PLAIN

7

8java.security.auth.login.config=/etc/kafka/kafka_client_jaas.confkafka.properties 可以作为 resources 文件与代码一起打包,代码运行时会在 classpath 中寻找 kafka.properties 文件资源;也可以在运行代码时将 kafka.properties 置于进程工作目录同级的 config 目录下。

步骤五:编写测试代码

- 需要关注并自行修改的参数

| 参数名 | 含义 |

|---|---|

| path | 接入点信息kafka.properties所在路径(建议写文件所在的绝对路径) |

| topic | 主题名称 |

| message | 消息的具体内容 |

| group_id | 消费组id |

生产者代码示例

创建KafkaProducerDemo.java文件,具体代码示例如下:

1package org.example.Java示例.SASL_PLAINTEXT;

2

3import org.apache.kafka.clients.producer.KafkaProducer;

4import org.apache.kafka.clients.producer.ProducerConfig;

5import org.apache.kafka.clients.producer.ProducerRecord;

6import org.apache.kafka.clients.producer.RecordMetadata;

7

8import java.io.File;

9import java.io.FileInputStream;

10import java.io.IOException;

11import java.util.Properties;

12

13public class KafkaProducerDemo {

14 public static void main(String[] args) throws IOException {

15

16 // 需要自行配置下面三个参数

17 // kafka.properties所在路径(建议写文件所在的绝对路径)

18 String path = "kafka.properties";

19 // 主题名称-topic name

20 String topic = "test";

21 // 消息内容

22 String message = "kafka java test";

23

24 // 创建配置类,并获取配置文件 kafka.properties 的内容。

25 Properties properties = new Properties();

26 File file = new File(path);

27 try {

28 if (file.exists()) {

29 // 如果通过用户指定的path路径找到了kafka.properties文件,则加载kafka.properties中的配置项

30 properties.load(new FileInputStream(file));

31 } else {

32 // 如果没有从path中找到,则从KafkaProducerDemo所在的路径去查找

33 properties.load(

34 KafkaProducerDemo.class.getClassLoader().getResourceAsStream("kafka.properties")

35 );

36 }

37 } catch (IOException e) {

38 // 没找到kafka.properties文件,在此处处理异常

39 throw e;

40 }

41

42 // 设置 java.security.auth.login.config,用于加载kafka_client_jaas.conf文件

43 if (null == System.getProperty("java.security.auth.login.config")) {

44 System.setProperty(

45 "java.security.auth.login.config",

46 properties.getProperty("java.security.auth.login.config")

47 );

48 }

49

50 // Kafka消息的序列化方式。

51 properties.put(ProducerConfig.KEY_SERIALIZER_CLASS_CONFIG, "org.apache.kafka.common.serialization.StringSerializer");

52 properties.put(ProducerConfig.VALUE_SERIALIZER_CLASS_CONFIG, "org.apache.kafka.common.serialization.StringSerializer");

53 // 请求的最长等待时间。

54 properties.put(ProducerConfig.MAX_BLOCK_MS_CONFIG, 30 * 1000);

55 // 设置客户端内部重试次数。

56 properties.put(ProducerConfig.RETRIES_CONFIG, 5);

57 // 设置客户端内部重试间隔。

58 properties.put(ProducerConfig.RECONNECT_BACKOFF_MS_CONFIG, 3000);

59

60 // 构建kafkaProducer对象

61 KafkaProducer<String, String> kafkaProducer = new KafkaProducer<>(properties);

62

63 try {

64 // 向指定的topic发送100条消息

65 for (int i = 0; i < 100; i++) {

66 // 通过 ProducerRecord 构造一个消息对象

67 ProducerRecord<String, String> kafkaMessage = new ProducerRecord<>(topic, message + "-" + i);

68 // 通过kafkaProducer发送消息

69 kafkaProducer.send(kafkaMessage, (RecordMetadata recordMetadata, Exception e) -> {

70 // 发送信息后的回调函数,用以验证消息是否发送成功

71 if (e == null) {

72 System.out.println("send success:" + recordMetadata.toString());

73 } else {

74 e.printStackTrace();

75 System.err.println("send failed");

76 }

77 });

78 }

79 }catch (Exception e){

80 System.out.println(e.getMessage());

81 e.printStackTrace();

82 }finally {

83 // 不要忘记关闭资源

84 kafkaProducer.close();

85 }

86 }

87}消费者代码示例

创建KafkaConsumerDemo.java文件,具体代码示例如下:

1package org.example.Java示例.SASL_PLAINTEXT;

2

3import org.apache.kafka.clients.consumer.ConsumerConfig;

4import org.apache.kafka.clients.consumer.ConsumerRecord;

5import org.apache.kafka.clients.consumer.ConsumerRecords;

6import org.apache.kafka.clients.consumer.KafkaConsumer;

7

8import java.io.File;

9import java.io.FileInputStream;

10import java.io.IOException;

11import java.time.Duration;

12import java.util.Collections;

13import java.util.Properties;

14

15public class KafkaConsumerDemo {

16 public static void main(String[] args) throws IOException {

17

18 // 需要自行配置下面三个参数

19 // kafka.properties所在路径(建议写文件所在的绝对路径)

20 String path = "kafka.properties";

21 // 主题名称-topic name

22 String topic = "test";

23 // 消费组id

24 String group_id = "test_group";

25

26 // 创建配置类,并获取配置文件 kafka.properties 的内容。

27 Properties properties = new Properties();

28 File file = new File(path);

29 try {

30 if (file.exists()) {

31 // 如果通过用户指定的path路径找到了kafka.properties文件,则加载kafka.properties中的配置项

32 properties.load(new FileInputStream(file));

33 } else {

34 // 如果没有从path中找到,则从KafkaProducerDemo所在的路径去查找

35 properties.load(

36 KafkaProducerDemo.class.getClassLoader().getResourceAsStream("kafka.properties")

37 );

38 }

39 } catch (IOException e) {

40 // 没找到kafka.properties文件,在此处处理异常

41 throw e;

42 }

43

44 // 设置 java.security.auth.login.config,用于加载kafka_client_jaas.conf文件

45 if (null == System.getProperty("java.security.auth.login.config")) {

46 System.setProperty(

47 "java.security.auth.login.config",

48 properties.getProperty("java.security.auth.login.config")

49 );

50 }

51

52 // Kafka消息的序列化方式

53 properties.put(ConsumerConfig.KEY_DESERIALIZER_CLASS_CONFIG, "org.apache.kafka.common.serialization.StringDeserializer");

54 properties.put(ConsumerConfig.VALUE_DESERIALIZER_CLASS_CONFIG, "org.apache.kafka.common.serialization.StringDeserializer");

55 // 指定消费组id

56 properties.put(ConsumerConfig.GROUP_ID_CONFIG, group_id);

57 // enable.auto.commit如果为true,则消费者的偏移量将定期在后台提交。

58 properties.put(ConsumerConfig.ENABLE_AUTO_COMMIT_CONFIG, "true");

59 // 重置消费位点策略:earliest、latest、none

60 properties.put(ConsumerConfig.AUTO_OFFSET_RESET_CONFIG, "earliest");

61 // 设置kafka自动提交offset的频率,默认5000ms,也就是5s

62 properties.put(ConsumerConfig.AUTO_COMMIT_INTERVAL_MS_CONFIG, 1000);

63 // 设置消费者在一次poll中返回的最大记录数

64 properties.put(ConsumerConfig.MAX_POLL_RECORDS_CONFIG, 1000);

65 // 设置消费者两次poll的最大时间间隔

66 properties.put(ConsumerConfig.MAX_POLL_INTERVAL_MS_CONFIG, 1000);

67

68 // 构建KafkaConsumer对象

69 KafkaConsumer<String, String> kafkaConsumer = new KafkaConsumer<>(properties);

70

71 //订阅主题

72 kafkaConsumer.subscribe(Collections.singleton(topic));

73

74 try{

75 //持续消费主题中的消息

76 while(true){

77 // 构建ConsumerRecord用于接收存储消息

78 ConsumerRecords<String, String> kafkaMessage = kafkaConsumer.poll(Duration.ofMillis(5000));

79 for (ConsumerRecord<String, String> consumerRecord : kafkaMessage) {

80 // 打印消息具体内容

81 System.out.printf("offset = %d, key = %s, value = %s%n", consumerRecord.offset(), consumerRecord.key(), consumerRecord.value());

82 }

83 }

84 }catch (Exception e){

85 System.out.println(e.getMessage());

86 e.printStackTrace();

87 }finally {

88 kafkaConsumer.close();

89 }

90 }

91}步骤六:编译并运行

编译并运行上述两个代码文件。

- 先启动KafkaConsumerDemo.java

- 再启动KafkaProducerDemo.java

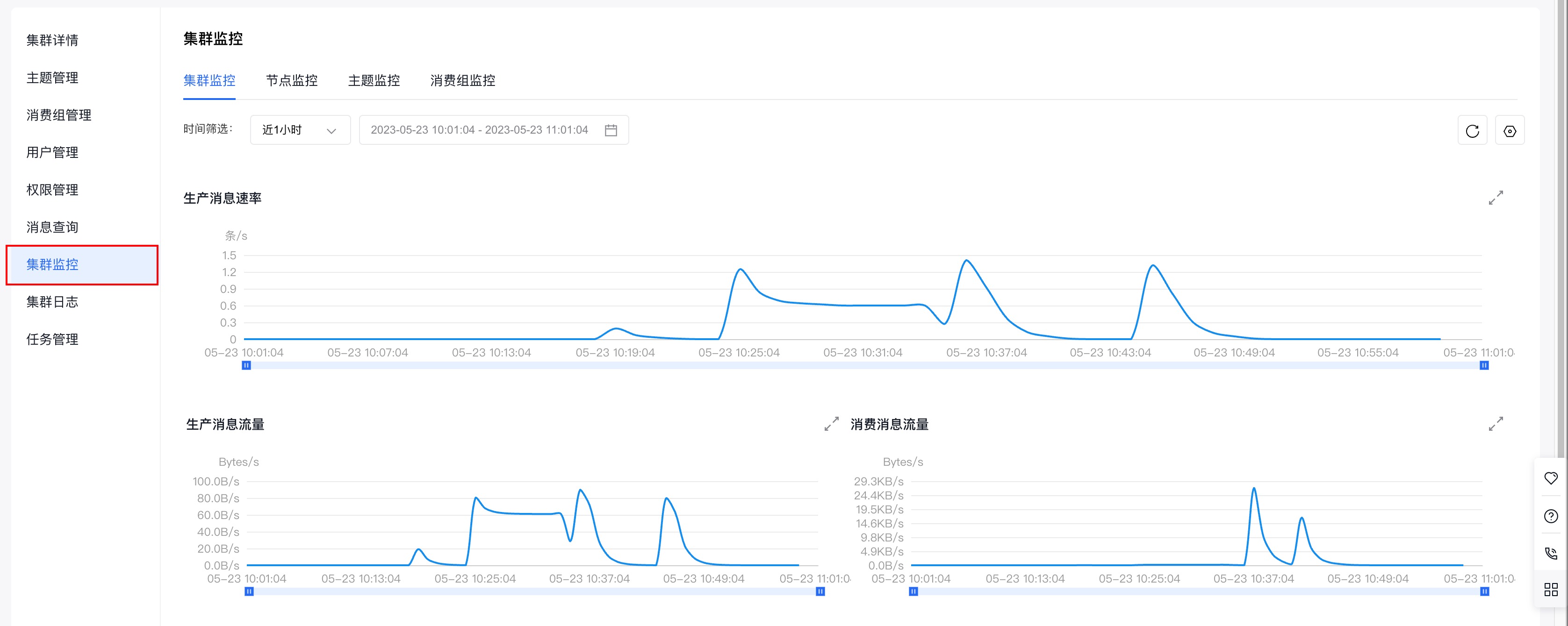

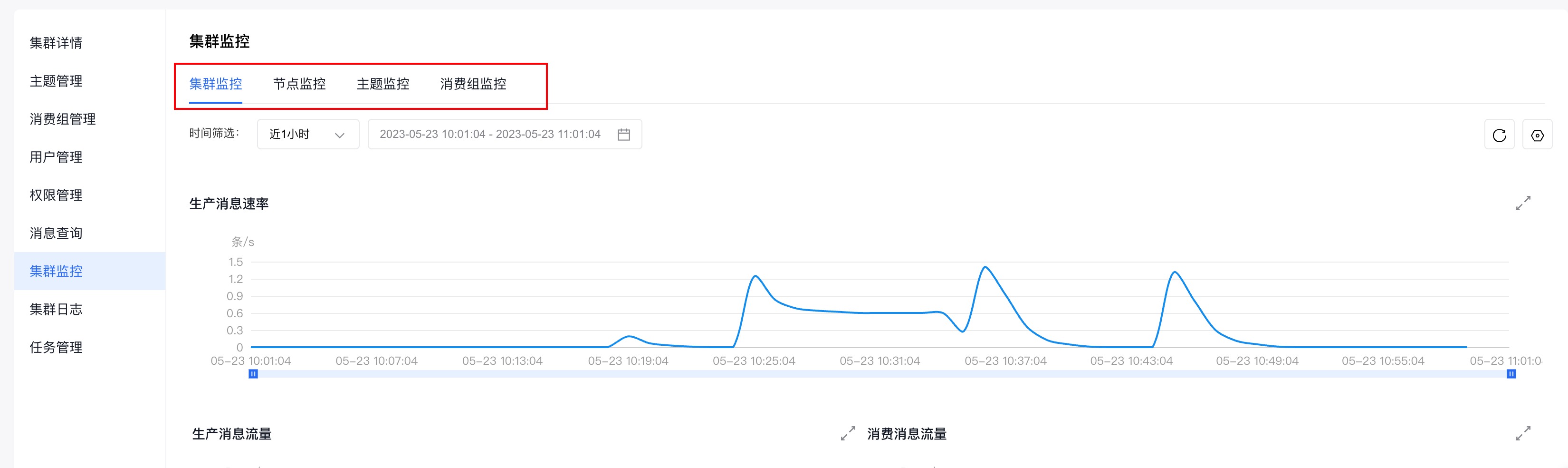

步骤七:查看集群监控

查看消息是否发送成功或消费成功有两种方式:

- 查看程序输出日志。

- 在专享版消息服务 for Kafka控制台查看集群监控,获取集群生产、消息情况。

推荐使用第二种方式,下面介绍如何查看集群监控。

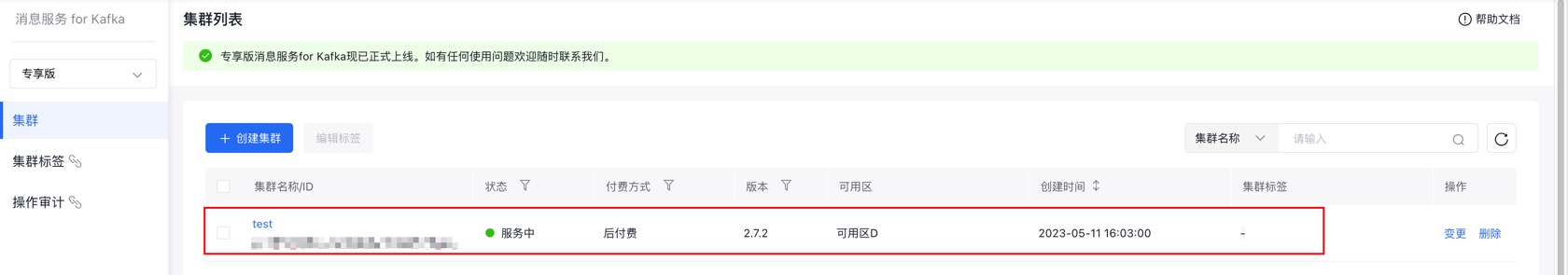

(1)在专享版消息服务 for Kafka的控制台页面找到需要连接的集群,点击集群名称进入『集群详情』页面。

(2)页面跳转后,进入左侧边中的『集群详情』页面。

(3)点击左侧边栏中的『集群监控』,进入『集群监控』页面。

(4)通过查看『集群监控』页面,提供的不同纬度的监控信息(集群监控、节点监控、主题监控、消费组监控),即可获知集群的生产和消费情况。

集群监控的具体使用请参考:集群监控

评价此篇文章