创建模型推理服务

概述

模型推理服务是 AI 原生网关上对外暴露的一条访问路径,相当于通用网关概念中的「路由」。通过创建模型推理服务,您可以定义一组匹配规则,将符合规则的请求按照设定的策略转发到一个或多个后端服务。

模型推理服务的目标后端既支持传统的容器服务、固定 IP、DNS 域名等资源,也支持对接 AI 模型代理。因此该模块同时适用于:

- 传统业务的路由分发:如 Web 应用、API 接口的请求转发与流量治理。

- AI 推理流量的统一接入:如对接 DeepSeek、百度千帆、OpenAI 等大模型服务,并在网关层统一做认证、限流、模型路由等。

前提条件

- 已创建 AI 原生网关实例。

- 已在「后端服务」中添加好需要对接的目标服务。

操作步骤

进入创建页面

- 登陆百度智能云 AI 原生网关控制台。

- 在顶部导航栏选择目标地域,并在实例列表中单击目标实例 ID,进入实例详情页。

- 在左侧导航栏选择 AI 服务 > 模型推理服务,进入模型推理服务列表页。

- 单击列表上方的 创建推理服务,进入创建页面。

配置基本信息

| 配置项 | 说明 |

|---|---|

| 推理服务名称 |

自定义服务名称。

|

| 访问模式 |

根据后端业务的访问形态选择:

|

| 关联域名(仅 API 接口访问模式) |

|

| 独立子域名(仅 Web 应用访问模式) |

|

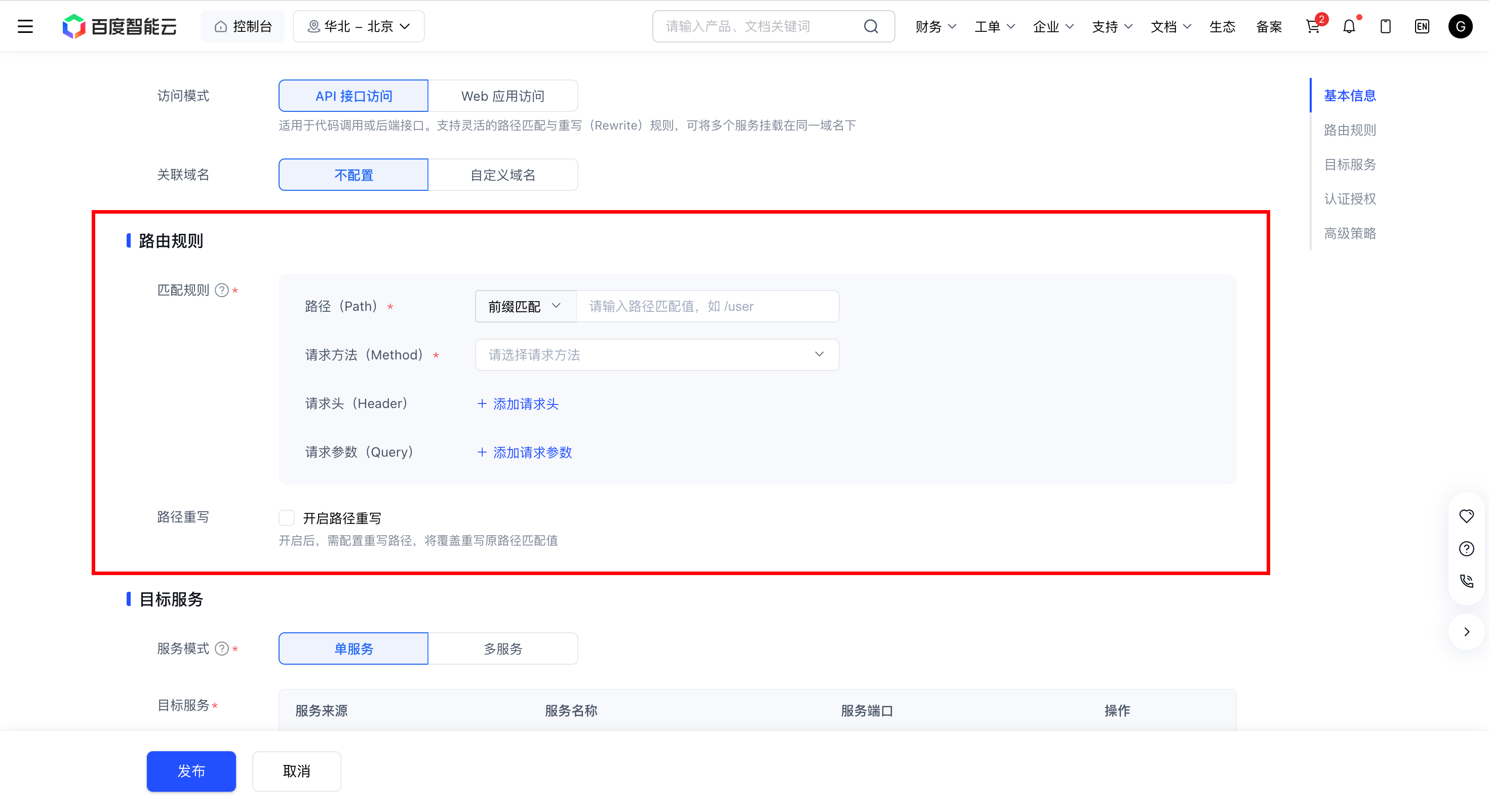

配置路由规则

说明:Web 应用访问模式无需配置匹配规则,请求会自动通过分配的独立子域名转发到后端,可跳过本步骤。

| 配置项 | 说明 |

|---|---|

| 路径(Path) |

指定允许访问的请求路径,支持三种匹配方式(注意:路径匹配区分大小写):

/ 开头。

|

| 请求方法(Method) |

必填,仅符合所选 HTTP 方法的请求才会被路由。支持多选,可选值:

|

| 请求头(Header) |

可选。仅当请求中包含指定 Header 时才会被路由。支持添加多条,每条包含:

|

| 请求参数(Query) | 可选。仅当请求 Query 中包含指定参数时才会被路由。支持添加多条,参数说明同 Header。 |

| 路径重写 |

开启后,可在请求转发到后端前对路径进行改写。 注意:当目标服务包含 AI 模型代理类型时,路径重写自动关闭且不可开启。 |

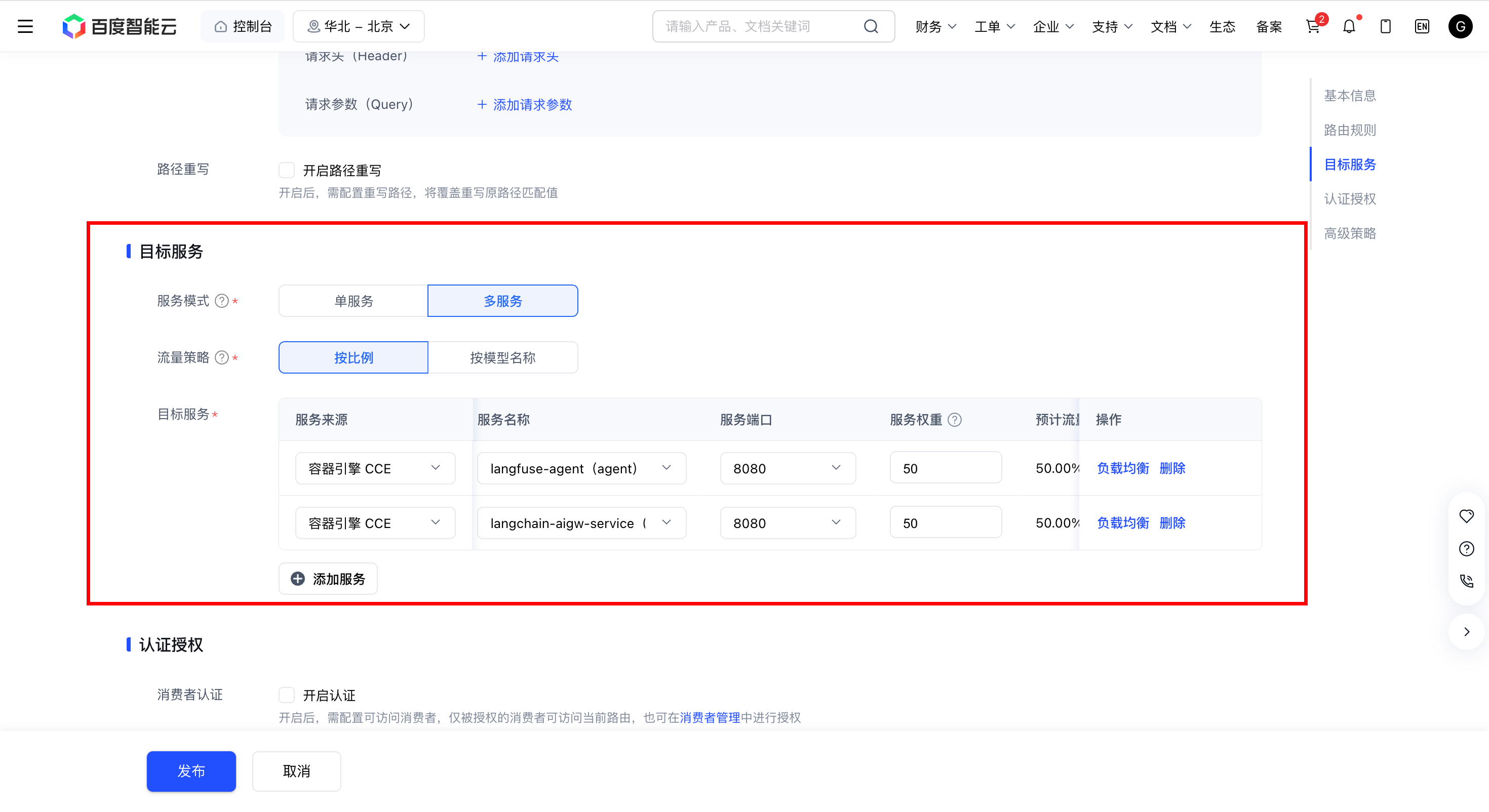

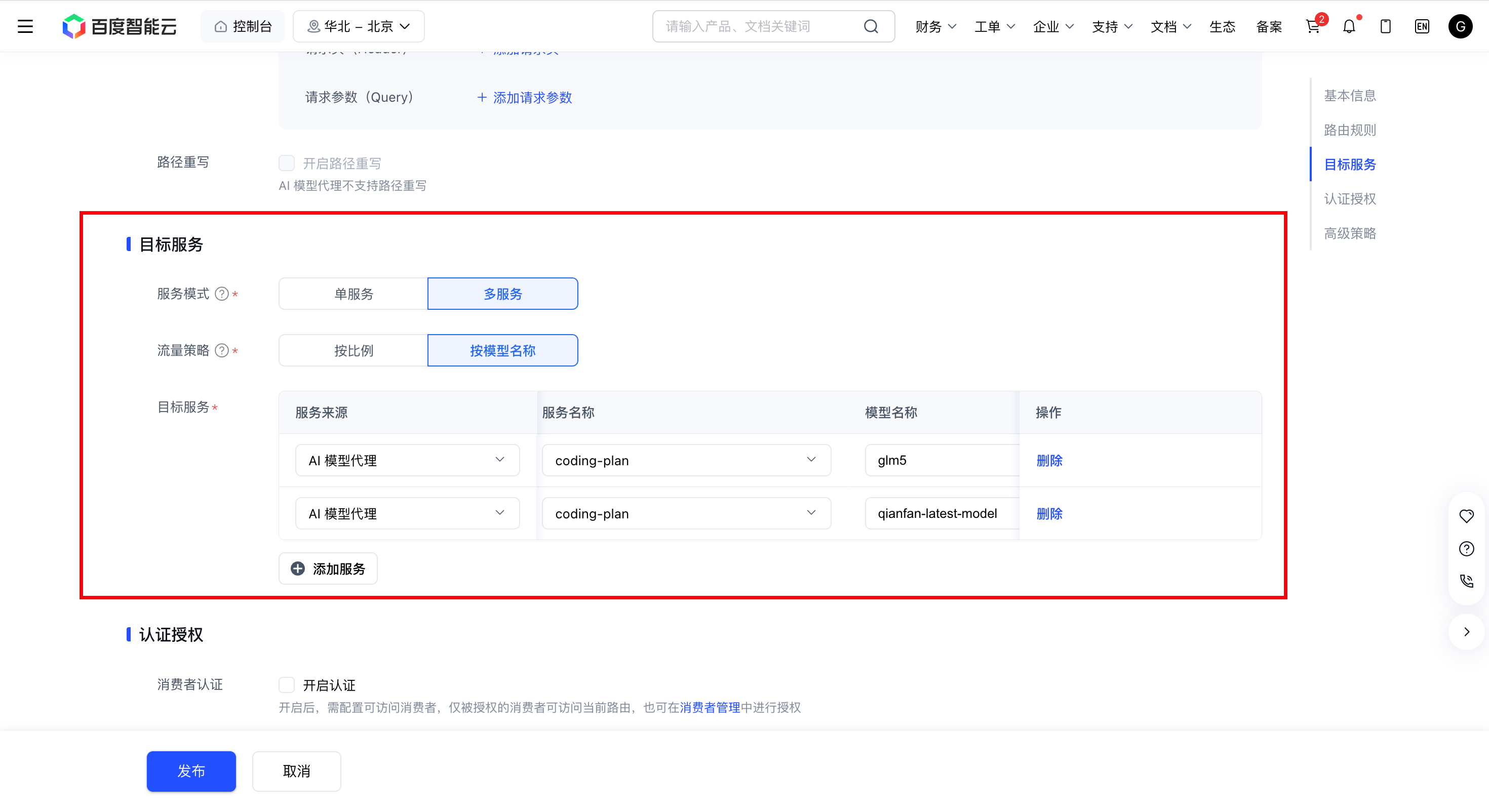

配置目标服务

目标服务用于声明请求最终被转发到的后端,支持单服务和多服务两种模式。多服务模式下还可进一步选择流量分发的策略。

| 配置项 | 说明 |

|---|---|

| 服务模式 |

|

| 流量策略(仅多服务) |

|

| 服务来源 |

每个目标服务需指定来源。不同模式下的可选来源:

|

| 服务名称 | 从所选来源的可用服务列表中选择。CCE 类型将在服务名称后同时显示所属命名空间。 |

| 服务端口 | 对接 CCE 类型服务时需指定端口,端口列表由所选 Service 暴露的端口自动列出。 |

| 服务权重 | 仅「多服务-按比例」策略下需要配置,为每个目标服务设置权重值。根据数字之间的比值进行按比例路由,数字越大,所占比例越高,数字范围为 0-10000。 |

| 模型名称 | 仅「多服务-按模型名称」策略下需要配置,为每个目标服务填写一个用于匹配请求体 model 字段的模型名称。 |

| 负载均衡算法 |

指定流量在目标服务后端节点之间的分发策略,支持:

|

| 模型传递方式(仅单服务 + AI 模型代理) |

当单服务模式下目标服务为 AI 模型代理类型时,可指定向上游传递的模型名称:

|

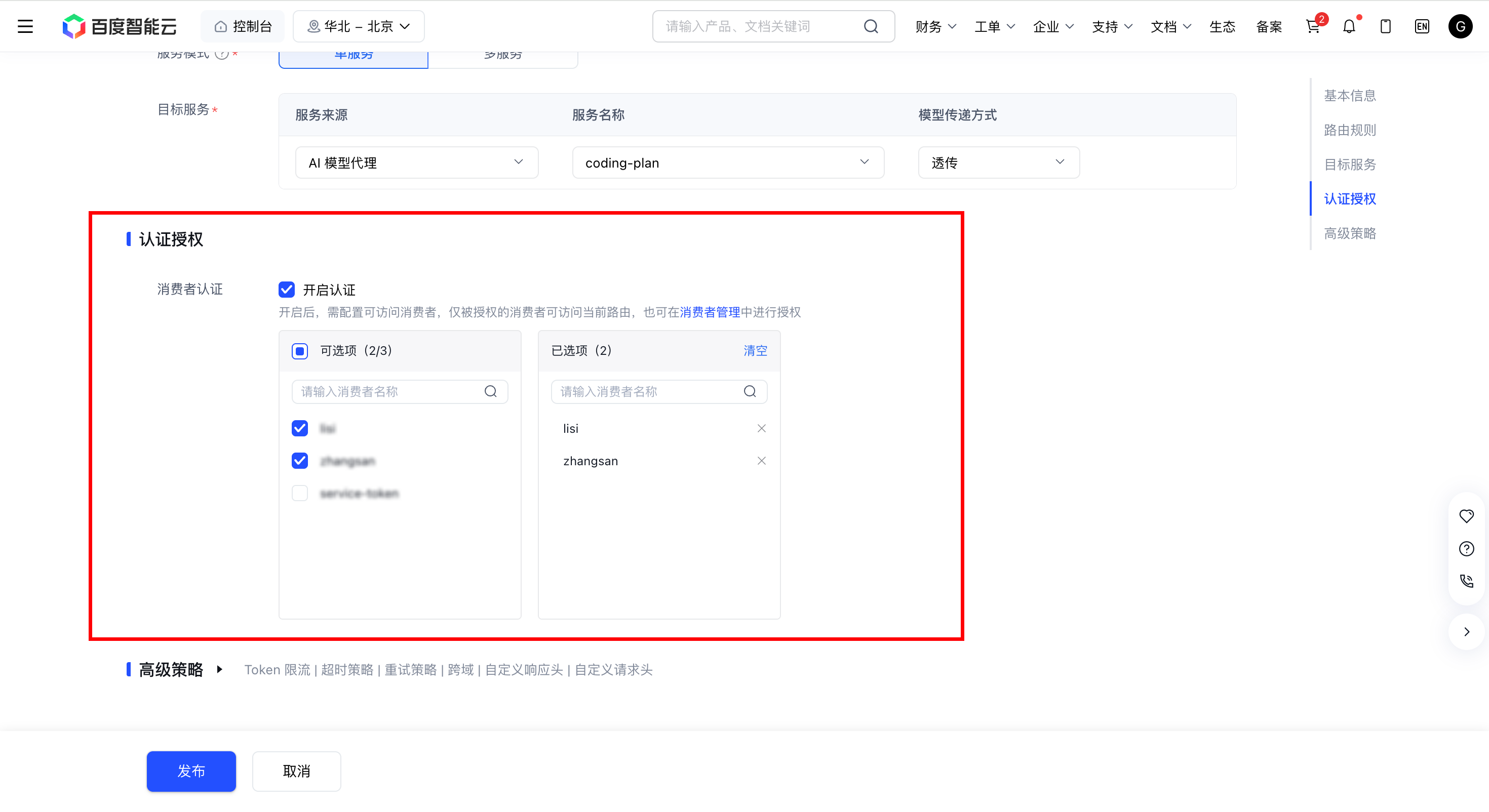

配置认证授权(可选)

开启认证授权后,需要配置可访问的消费者,仅被授权的消费者(Consumer)才能访问该模型推理服务。

- 打开「消费者认证」开关。

-

从「可选消费者」列表中选择需要授权的消费者,移动至「已选消费者」。

如暂无可用消费者,可前往「消费者管理」中先创建。

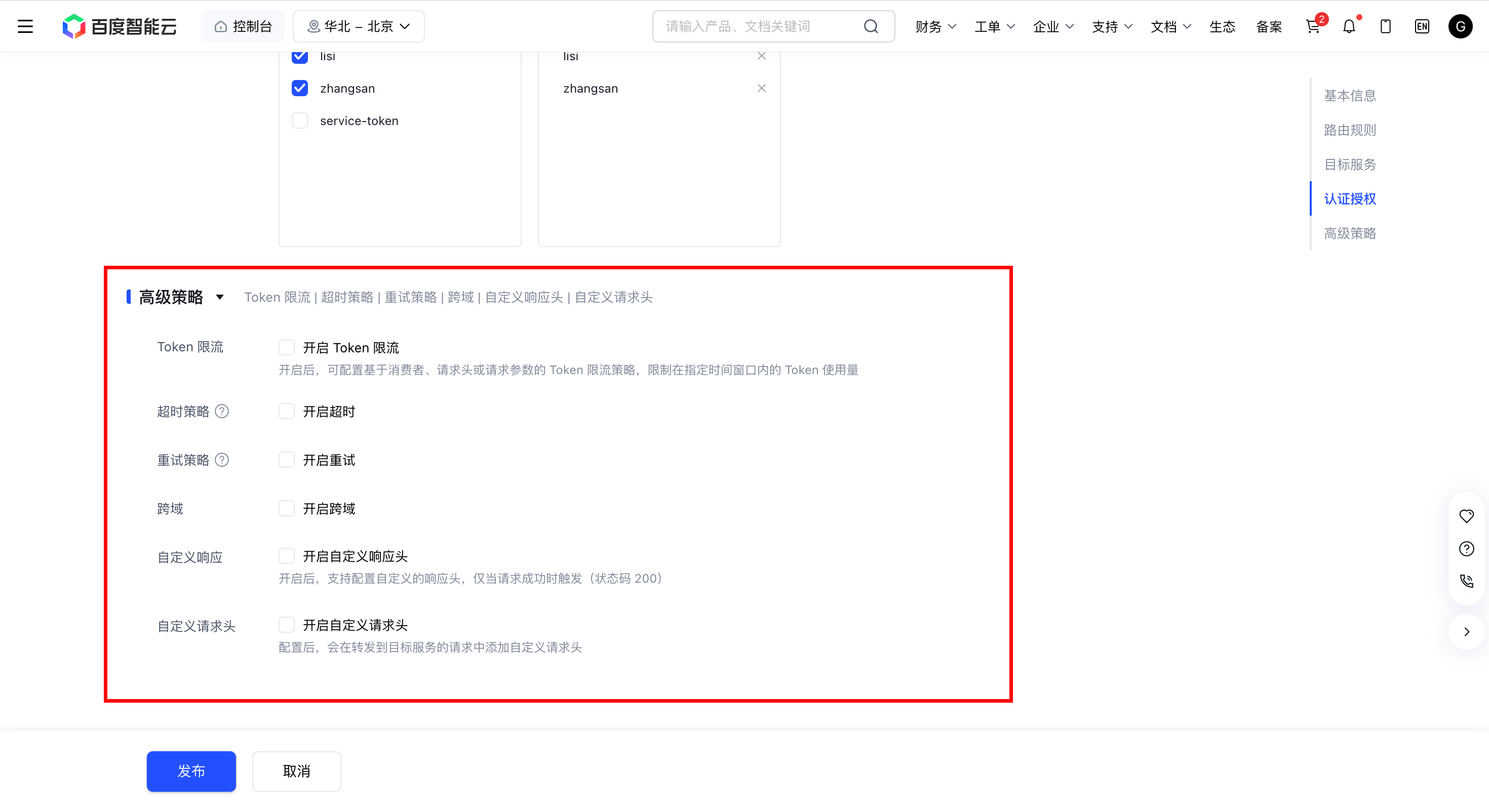

配置高级策略(可选)

模型推理服务支持配置以下高级策略,按需开启即可。各策略的详细参数说明请参见对应的策略文档。

| 策略 | 说明 |

|---|---|

| Token 限流 | 按消费者、Header 或请求参数等维度限制单位时间内可消耗的 Token 数量(输入+输出)。 |

| 超时策略 | 设置请求转发到后端的超时时间,单位为秒。 |

| 重试策略 | 设置重试条件(如连接失败、5xx、特定 gRPC 状态码等)和重试次数。 |

| 跨域策略(CORS) | 配置允许跨域的来源、方法、请求头、响应头、是否允许凭证、预检缓存时间等。 |

| 自定义请求头 | 在请求转发到后端前,向请求中追加自定义 Header。 |

| 自定义响应头 | 在响应返回客户端前,向响应中追加自定义 Header。 |

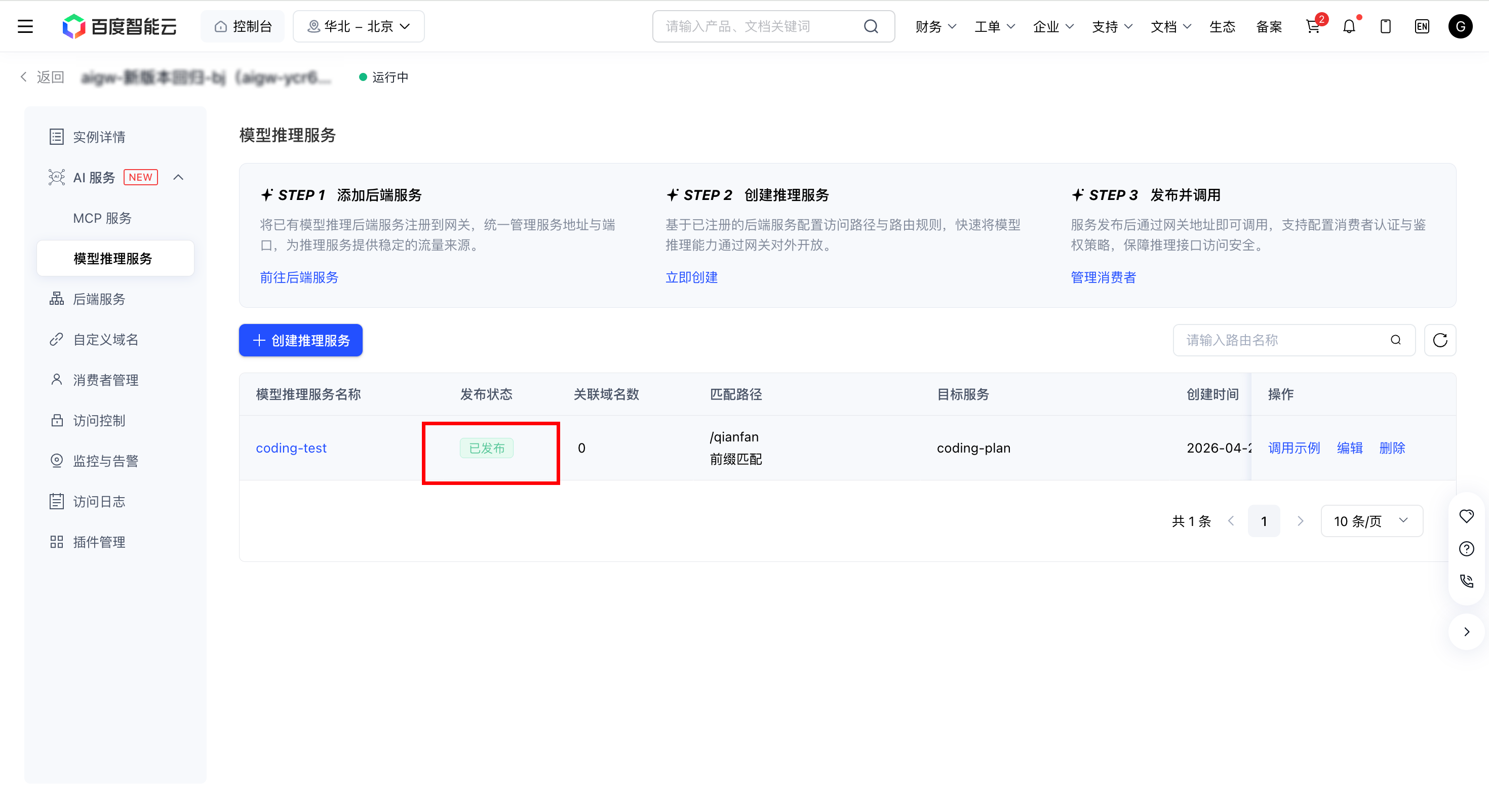

完成创建

确认所有配置无误后,单击页面底部的 发布 按钮,完成模型推理服务的创建。创建成功后,自动跳转回模型推理服务列表,新创建的服务会出现在列表中。

场景配置示例

场景一:统一代理第三方大模型 API

适用场景:希望客户端只对接 AI 原生网关,由网关统一代理请求到 DeepSeek、百度千帆、OpenAI 等第三方大模型,便于在网关侧统一做认证、限流、计量。

配置思路:

| 配置项 | 建议取值 |

|---|---|

| 访问模式 | API 接口访问 |

| 关联域名 | 不配置(使用网关默认入口)或自定义域名 |

| 路径 | /proxy/v1,前缀匹配 |

| 请求方法 | 勾选 POST 与 GET(覆盖 /chat/completions 等 POST 接口与 /models 等 GET 接口) |

| 服务模式 | 单服务 |

| 服务来源 | AI 模型代理 |

| 服务名称 | 选择「后端服务」中已添加的 AI 模型代理服务 |

| 模型传递方式 | 透传(保留客户端原始的 model 字段) |

调用效果:客户端按 OpenAI 协议向网关发起请求,网关将整段请求(包含 model 字段)转发到上游模型供应商,返回结果由网关原样回传。

调用示例:将下方示例中的 <aigw-domain> 替换为该实例的网关默认域名(或您配置的自定义域名),<your-model> 替换为上游供应商支持的模型(如 deepseek-chat)。

1curl http://<aigw-domain>/proxy/v1/chat/completions \

2 -H "Content-Type: application/json" \

3 -d '{

4 "model": "<your-model>",

5 "messages": [{"role": "user", "content": "你好"}]

6 }'如使用 OpenAI 官方 SDK,可将 base_url 指向网关:

1from openai import OpenAI

2

3client = OpenAI(

4 base_url="http://<aigw-domain>/proxy/v1",

5 api_key="not-used" # 实际鉴权由网关侧消费者认证完成

6)

7resp = client.chat.completions.create(

8 model="<your-model>",

9 messages=[{"role": "user", "content": "你好"}]

10)场景二:将自建推理服务以 OpenAI 兼容 API 暴露

适用场景:在 CCE 上自行部署了 vLLM、Ollama 等推理引擎并提供 OpenAI 兼容协议,希望通过网关统一对外暴露访问入口。

配置思路:

| 配置项 | 建议取值 |

|---|---|

| 访问模式 | API 接口访问 |

| 路径 | /inhouse/v1,前缀匹配 |

| 请求方法 | 勾选 POST 与 GET(覆盖 /chat/completions 等 POST 接口与 /models 等 GET 接口) |

| 服务模式 | 单服务 |

| 服务来源 | 容器引擎 CCE |

| 服务名称 | 选择对应的 K8s Service |

| 服务端口 | 与推理服务实际监听端口一致(如 vLLM 默认的 8000) |

| 负载均衡算法 | 轮询(默认);如需保持会话黏性,可选「哈希一致性」 |

调用效果:客户端将 OpenAI SDK 的 base_url 指向网关,即可像调用 OpenAI 一样访问您自建的推理服务。

调用示例:将 <aigw-domain> 替换为该实例的网关默认域名或自定义域名,<your-deployed-model> 替换为推理引擎中实际加载的模型名(如 Qwen2.5-7B-Instruct)。

1curl http://<aigw-domain>/inhouse/v1/chat/completions \

2 -H "Content-Type: application/json" \

3 -d '{

4 "model": "<your-deployed-model>",

5 "messages": [{"role": "user", "content": "Hello"}]

6 }'1from openai import OpenAI

2

3client = OpenAI(

4 base_url="http://<aigw-domain>/inhouse/v1",

5 api_key="not-used"

6)

7resp = client.chat.completions.create(

8 model="<your-deployed-model>",

9 messages=[{"role": "user", "content": "Hello"}]

10)场景三:限定可访问的模型范围

适用场景:希望同一个 AI 模型代理服务上仅暴露指定的几个模型给业务方,未在白名单中的模型请求被网关直接拒绝,避免业务方误调用未授权或高成本模型。

配置思路:

| 配置项 | 建议取值 |

|---|---|

| 访问模式 | API 接口访问 |

| 路径 | /whitelist/v1/chat/completions,精确匹配 |

| 请求方法 | 仅勾选 POST(/chat/completions 接口仅接受 POST 请求) |

| 服务模式 | 多服务 |

| 流量策略 | 按模型名称 |

| 目标服务(多行) |

所有行的服务来源均选择「AI 模型代理」,且服务名称选择同一个 AI 模型代理服务,例如:

|

调用效果:客户端请求体中 model 为 deepseek-chat 或 deepseek-reasoner 时正常转发;为其他值(如 gpt-4)时被网关拒绝。

调用示例:

允许的模型,请求正常返回:

1curl http://<aigw-domain>/whitelist/v1/chat/completions \

2 -H "Content-Type: application/json" \

3 -d '{

4 "model": "deepseek-chat",

5 "messages": [{"role": "user", "content": "你好"}]

6 }'未配置的模型,请求被网关拒绝:

1curl http://<aigw-domain>/whitelist/v1/chat/completions \

2 -H "Content-Type: application/json" \

3 -d '{

4 "model": "gpt-4",

5 "messages": [{"role": "user", "content": "你好"}]

6 }'

7 # 网关返回错误,请求未被转发到上游场景四:按比例灰度发布新版本推理服务

适用场景:新部署了一组推理节点,希望先承担少量流量进行稳定性验证,确认无问题后再逐步增大权重直至全量切换。

配置思路:

| 配置项 | 建议取值 |

|---|---|

| 访问模式 | API 接口访问 |

| 路径 | /canary/v1,前缀匹配 |

| 请求方法 | 勾选 POST 与 GET 或者直接全选(与原服务保持一致即可,避免灰度版本与全量版本因方法范围不同导致请求落点不一致) |

| 服务模式 | 多服务 |

| 流量策略 | 按比例 |

| 目标服务(多行) |

|

调用效果:网关将约 90% 的请求分发到旧版本,10% 分发到新版本。验证稳定后,可在「编辑」页面调整权重,逐步将新版本权重提升至全量。

调用示例:调用方式与单服务一致,客户端无需感知后端的版本切分。多次调用同一接口,网关会按权重自动分发:

1 # 同一条命令多次执行,约 9 次落到旧版本、1 次落到新版本

2curl http://<aigw-domain>/canary/v1/chat/completions \

3 -H "Content-Type: application/json" \

4 -d '{

5 "model": "<your-deployed-model>",

6 "messages": [{"role": "user", "content": "Hello"}]

7 }'场景五:将 AI Web 应用暴露给浏览器访问

适用场景:在内部部署了 Stable Diffusion WebUI、Open-WebUI、Dify 等通过浏览器访问的 AI 可视化应用,希望直接获得一个独立子域名供用户访问,无需配置复杂的路径规则。

配置思路:

| 配置项 | 建议取值 |

|---|---|

| 访问模式 | Web 应用访问 |

| 独立子域名 | 选择「自定义」并填写服务标识,如 sd-webui |

| 后端服务路径 |

默认 /。仅当后端 Web 应用运行在非根目录时需要填写。例如 Open-WebUI 默认运行在 /,保持默认即可;若您将应用部署到 /sd 子路径下,则需要填 /sd,否则用户访问独立子域名时网关会把请求转发到后端的根路径,导致 404。

|

| 服务模式 | 单服务 |

| 服务来源 | 容器引擎 CCE |

| 服务名称 / 端口 | 选择 Web 应用对应的 K8s Service 及监听端口 |

调用效果:创建成功后,系统会基于服务标识分配独立的公网与内网子域名(如 sd-webui-aigw-pub.<region>.baidubce.com),用户在浏览器中直接访问该域名即可使用对应的 AI Web 应用。

调用示例:

-

在公网环境下,用户直接在浏览器地址栏中访问:

Plain Text1http://sd-webui-aigw-pub.<region>.baidubce.com -

在与网关同 VPC 的内网环境下,用户访问:

Plain Text1http://sd-webui-aigw-vpc.<region>.baidubce.com

实际域名以服务创建成功后系统分配的为准,可在模型推理服务详情中查看。

评价此篇文章