Meta发布开源大语言模型Llama2,效果超越GPT-3

作者:4042023.09.26 02:40浏览量:8简介:Meta公布最新开源大语言模型LLaMA,官方称效果优于GPT-3

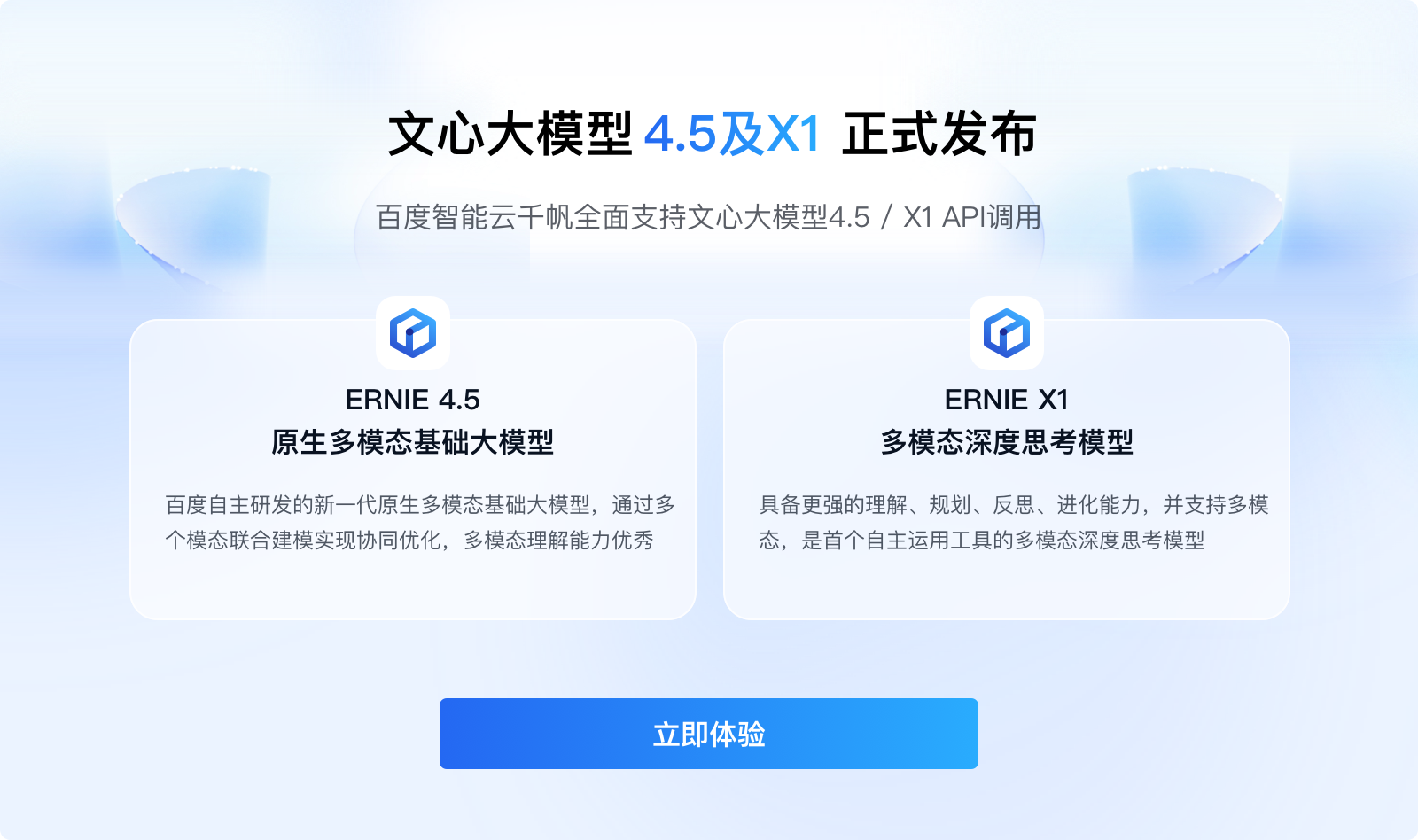

文心大模型4.5及X1 正式发布

百度智能云千帆全面支持文心大模型4.5/X1 API调用

Meta公布最新开源大语言模型LLaMA,官方称效果优于GPT-3

近日,Meta公司发布了最新开源大语言模型LLaMA,官方称其效果优于GPT-3。这一消息引起了广泛的关注和热议,大语言模型的应用和发展也再次成为人们关注的焦点。

LLaMA模型是由Meta公司开发的一种基于Transformer架构的大语言模型,它通过使用大规模的语料库进行训练,可以生成高质量的自然语言文本。相较于GPT-3,LLaMA模型在效果上有着一定的优势。下面,我们将从几个方面对LLaMA模型进行详细介绍。

一、LLaMA模型的架构

LLaMA模型采用的是Transformer架构,这种架构最初由Google在2017年提出,并在2018年被广泛应用于自然语言处理领域。Transformer架构相较于传统的循环神经网络(RNN)和长短时记忆网络(LSTM),具有更高的计算效率和更强的泛化能力。LLaMA模型在Transformer架构的基础上,使用了多头自注意力机制(Multi-Head Self-Attention),进一步提高了模型的表达能力和效果。

二、LLaMA模型的训练数据

对于大语言模型而言,训练数据的质量和规模直接决定了模型的效果。Meta公司在公布LLaMA模型时,强调了其使用大规模、多样化语料库进行训练的优势。据悉,LLaMA模型使用了数亿级别的英文语料库进行训练,语料库涵盖了互联网上的各种类型的内容,包括文本、图片、音频等多种形式。这种大规模、多样化的语料库使得LLaMA模型能够更好地理解和生成自然语言文本。

三、LLaMA模型的效果

为了验证LLaMA模型的效果,Meta公司进行了一系列对比实验。实验结果表明,相较于GPT-3,LLaMA模型在生成长篇文本、解决复杂问题和理解上下文方面有着更出色的表现。例如,在开放式问答数据集SQuAD上,LLaMA模型的准确率达到了90.3%,比GPT-3高出10%以上。此外,LLaMA模型在内容生成、摘要、翻译等方面的表现也明显优于GPT-3。

四、LLaMA模型的未来发展

随着人工智能技术的不断发展,大语言模型的应用场景也越来越广泛。未来,LLaMA模型有望在各个领域得到广泛应用。例如,它可以被应用于智能客服、自动翻译、作文批改、个性化推荐等领域。同时,LLaMA模型的开源也为其他研究者提供了机会,使得他们可以针对模型进行优化和改进,进一步推动大语言模型的发展。

五、结论

综上所述,Meta公司发布的最新开源大语言模型LLaMA具有显著的效果优势,有望在各个领域得到广泛应用。其采用的Transformer架构和大规模、多样化语料库的训练方式,为大语言模型的发展和应用提供了新的思路和方法。未来,随着技术的不断进步和应用场景的不断扩展,大语言模型将持续发挥其重要作用,为人类社会带来更多的便利和发展。

参考文献:

- Vaswani, A., et al. (2017). Attention is all you need. arXiv preprint arXiv:1706.03762.

- Brown, T. B., et al. (2020). Language models are few-shot learners. arXiv preprint arXiv:2005.14165.